Grammarly默认盗用作者身份,AI伦理再陷争议

当你的名字被AI“借用”时,你甚至毫不知情

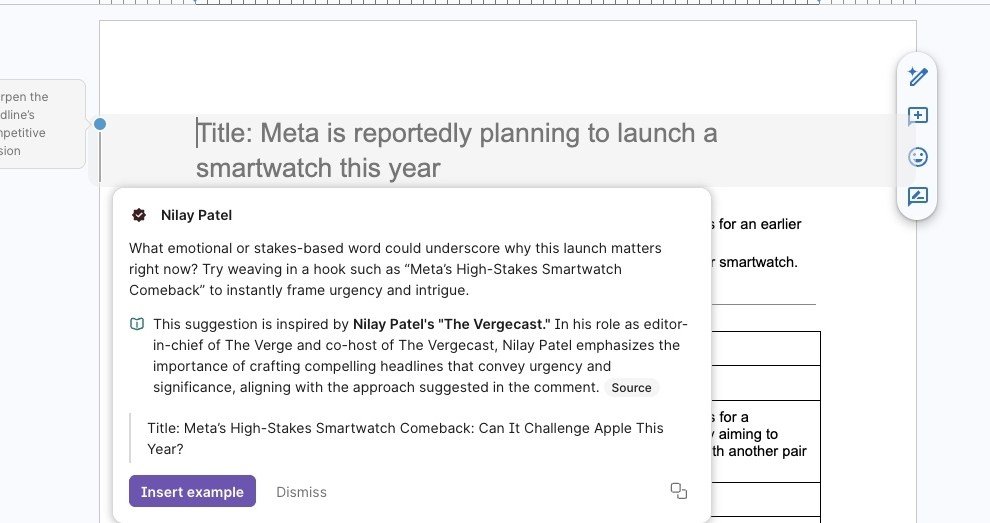

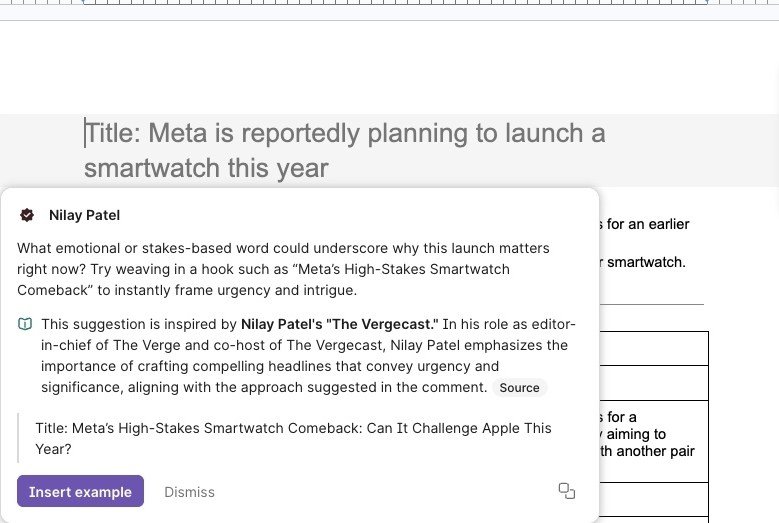

上周,科技圈爆出一则令人啼笑皆非的新闻:知名写作助手Grammarly悄悄将多位记者和作者的名字“征用”了。你没看错,不是邀请,不是授权,而是直接拿来就用。这些名字被贴在了其新功能“专家评审”上,仿佛这些真实的人类专家在背后为AI的修改建议背书。

受害者名单包括The Verge的主编Nilay Patel、资深记者David Pierce和Tom Warren,甚至还有更多不知名的作者。更讽刺的是,大多数人直到媒体报道才意识到自己的身份已被“AI化”。这就像你突然发现自己的照片被用在某个减肥广告上,而你从未同意过。

退出?不,你首先得知道发生了什么

面对舆论压力,Grammarly的回应堪称“经典公关案例”。公司没有道歉,也没有撤回功能,而是“慷慨地”提供了一个退出选项:发邮件到expertoptout@superhuman.com。副总裁Alex Gay在声明中强调,公司希望“让这些观点背后的人有更多控制权”,但通篇未提“许可”二字。

这引发了更深层的质疑:如果作者根本不知道Grammarly的存在,如何保护自己的名字?难道数字时代的身份权变成了“不知者不罪,但活该被盗用”?有网友调侃:“下次是不是得每天谷歌自己名字,看看有没有被AI拿去打工?”

AI可信度的“捷径”,还是数据霸权的体现?

从技术角度看,Grammarly此举暴露了AI行业的一个常见陷阱:用人类权威为机器决策“镀金”。在自然语言处理领域,AI的建议本身应基于算法和数据,而非依赖名人效应。这不禁让人想起那些用爱因斯坦头像卖保健品的广告——逻辑类似,只是换了个科技外壳。

更深层的问题是,科技公司对用户数据的处理越来越“默认即同意”。从社交媒体的隐私设置到智能设备的语音收集,用户往往在不知情中“被参与”。Grammarly事件只是冰山一角,它提醒我们:在AI时代,个人身份可能成为最容易被“开源”的资源。

幽默背后,是严肃的伦理拷问

想象一下,如果Grammarly下次“借用”了你的名字来建议别人写情书,或者用某位科学家的名义修改论文——这不仅仅是搞笑,更可能引发法律纠纷。尽管公司发言人Jen Dakin表示“正在优化功能”,但仅靠一个退出邮箱,显然难以平息众怒。

行业观察者指出,这类做法可能违反欧盟的GDPR或加州的CCPA等数据保护法规,这些法规强调“明确同意”而非“默认使用”。未来,随着AI应用渗透到更多领域,类似的伦理争议只会越来越多。

结语:技术可以“智能”,但公司不能“智障”

Grammarly的初衷或许是好的:帮助用户发现有价值的观点。但实现方式却让人摇头。在极客文化中,我们崇尚“快速迭代,敢于试错”,但这绝不意味着可以忽略基本伦理。真正的创新,应当建立在尊重用户的基础上——无论是他们的数据,还是他们的名字。

下次当你使用AI工具时,不妨多问一句:它背后的“权威”是真的吗?或者,你的名字是否正在某个服务器上“无偿加班”?在这个数字身份越来越模糊的时代,保持警惕或许是我们唯一的“默认设置”。